TC分享第 270 期

TC分享第 270 期

2026 week 9

你永远会低估你一周可以做的事情,在这里记录一下我这周看到的好东西。有些链接可能需要科学上网。

本周摄影:

新闻思考

这周美以对伊朗发动大规模打击。路透称哈梅内伊在袭击中身亡,且多名伊朗高层同时遇害,包括国防部长阿米尔·纳西尔扎德、革命卫队总司令穆罕默德·帕克普尔,以及阿里·沙姆哈尼等。与此同时,关于前总统内贾德“身亡”的消息在传播,但缺乏一致的权威确认。

这次行动最“现代”的部分,是情报窗口。路透披露,美以锁定了一个关键时点:哈梅内伊与核心圈层开会;而会议时间从晚间提前到上午的变化,被情报捕捉到,行动也随之提前,以确保目标在场。 外界不知道具体用的是哪种手段,但“开会”本身就是风险:它把分散的权力节点压缩到同一空间,让安保、通信、后勤都变成可被观察和验证的信号。战争从“拼火力”变成“拼可见性”,可见性决定生死——这就是 21 世纪的残酷。

哈梅内伊的死亡并不自动等于“伊朗会变好”。他代表的是一种长期治理逻辑:把国内政治矛盾安全化,把外部压力军事化,把国家机器的重心放在“稳定与对抗”上。这样的体制往往不是靠一个人撑起来,而是靠一套安全系统与利益网络互相咬合。 今年 1 月的抗议与强力镇压提醒我们:锅盖下的社会张力仍在;路透还写到特朗普在那段时期多次公开警告伊朗当局,显示外部干预威胁也在积累。 所以“斩首”更可能带来两种相反的后果:

- 要么权力真空引发内斗,国家短期失序;

- 要么安全系统以战争为理由更强硬接管,把社会勒得更紧。

更糟糕的是,战争外溢比想象中快。路透写到,中东多国空域关闭或严重受限,迪拜、阿布扎比、多哈等枢纽航班大规模取消,数万旅客滞留,全球航空网络连锁瘫痪,油价也被进一步推高。 这让我产生一种强烈的不真实感:战争似乎发生在远方,但它先把你困在机场的地毯上。

把时间线再往前推,2025 年 6 月以色列对伊朗核设施与军事目标的打击,已经把“核问题”重新推向战场。可以回顾我233期的分享 而到了今天,最大的隐患仍然是:伊朗核武器究竟造到什么地步? 当核查变难、信息更黑箱,各方更容易用最坏情景做判断,于是误判升级的概率上升。世界就像进入一种“火药桶状态”:不是因为大家都想打,而是因为每个人都担心“再等一天就来不及”。

关于“特朗普通过杀掉独裁者能不能解决中东问题”,我更倾向于谨慎:斩首也许能改变短期筹码,甚至能打断某条指挥链,但它未必能自动交付一个更稳定的秩序。秩序靠的是制度、经济与可持续的安全安排,而不是单次的爆炸。 所以我对未来的预测是:短期很难结束,冲突可能在“报复—反报复—再升级”的回路里震荡;只有当某种可执行的停火条件出现(核风险管理、地区空域与航运恢复、各方重新定义底线),才可能真正降温。

科技新闻

【1】大疆起诉美国联邦通信委员会(FCC)

【2】FT报道,DeepSeek下周发V4,会是个多模态大模型

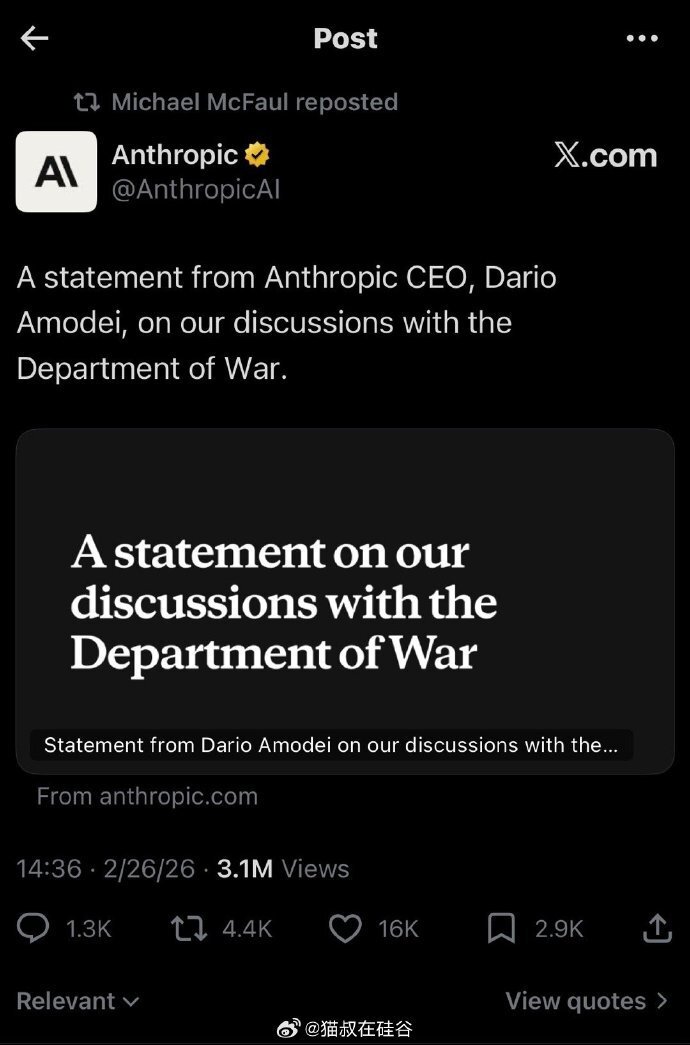

【3】彭博社报道,Anthropic今天公开指控三家中国AI公司——DeepSeek、MiniMax和Moonshot——违反其服务条款,通过数千个虚假账户与Claude模型共计产生超过1600万次对话交互,以非法手段提取Claude的能力。 这种做法被称为”蒸馏”,即用一个更强大模型的输出来训练较弱的模型,竞争对手可以借此以极少的时间和成本获取强大能力,而无需自主开发。 三家公司的参与程度不尽相同:DeepSeek产生了超过15万次交互,Moonshot AI超过340万次,MiniMax则超过1300万次。 Anthropic表示,这些公司使用了约2.4万个虚假账户,并通过代理服务绕过检测,提示词的数量、结构和侧重点与正常使用模式截然不同,明显是在针对性地提取能力,而非合法使用。 Anthropic警告称,“非法蒸馏的模型缺乏必要的安全防护措施,带来重大国家安全风险”,外国实验室可能将这些能力输入军事、情报和监控系统,使威权政府得以将前沿AI用于网络攻击行动。 早在2025年1月,OpenAI就曾指出DeepSeek可能”不当地”使用了其模型输出来训练自身模型,谷歌也在今年早些时候披露发现了蒸馏攻击活动的增加。 目前,DeepSeek、MiniMax和Moonshot均未立即回应置评请求。

【4】魅族退市

【5】三星内存向苹果报价涨幅 100%,苹果秒接,三星预期涨幅是 60%,一开始报 100% 是在等苹果拉扯砍价,没想到苹果直接答应了 @Vito的行研札记:赵本山: 这样啊,乱了啊,既然咱哥俩呢,你同意收藏,咱们重喊一次,听明白这5000到底是谁喊的?那个!起价多少? 徒弟: 2000! 范伟: 我2000! 赵本山: 成交!这回不乱了! 范伟: 不是,你不往上叫了啊? 赵本山: 对,我怕喊乱了! 范伟: 啊!别动啊,这轮椅是我的了!

【6】claude code之父的分享。 定位隐藏的bug,内存泄露,是很多技术人员拿高薪的核心技能,现在也被AI攻破了。

【7】OpenClaw 创始人:所有的 App,都是很慢的 API OpenClaw 创始人 Peter Steinberger 在 2 月中旬宣布加入 OpenAI 前后,接受了两场访谈。一场是老朋友 Andreas Klinger 的视频采访。Andreas 是欧洲早期科技基金 Prototype Capital 的创始人(曾任 Product Hunt 联合创始人兼 CTO),也是 YouTube 频道"Europe’s Most Ambitious Startups"的主理人,他从柏林飞到维也纳,在一场 OpenClaw 社区 meetup 结束后和 Peter 坐下来聊了 20 分钟。 另一场是 OpenAI 开发者体验负责人 Romain Huet 在旧金山录制的"Builders Unscripted"播客首期,Peter 在正式入职前详细讲述了自己的构建方法论和工作流。 Peter 在两场对话中反复说的,是同一个判断:我们现在使用的软件、组建的团队、开的会议,全都是上一个时代的产物。

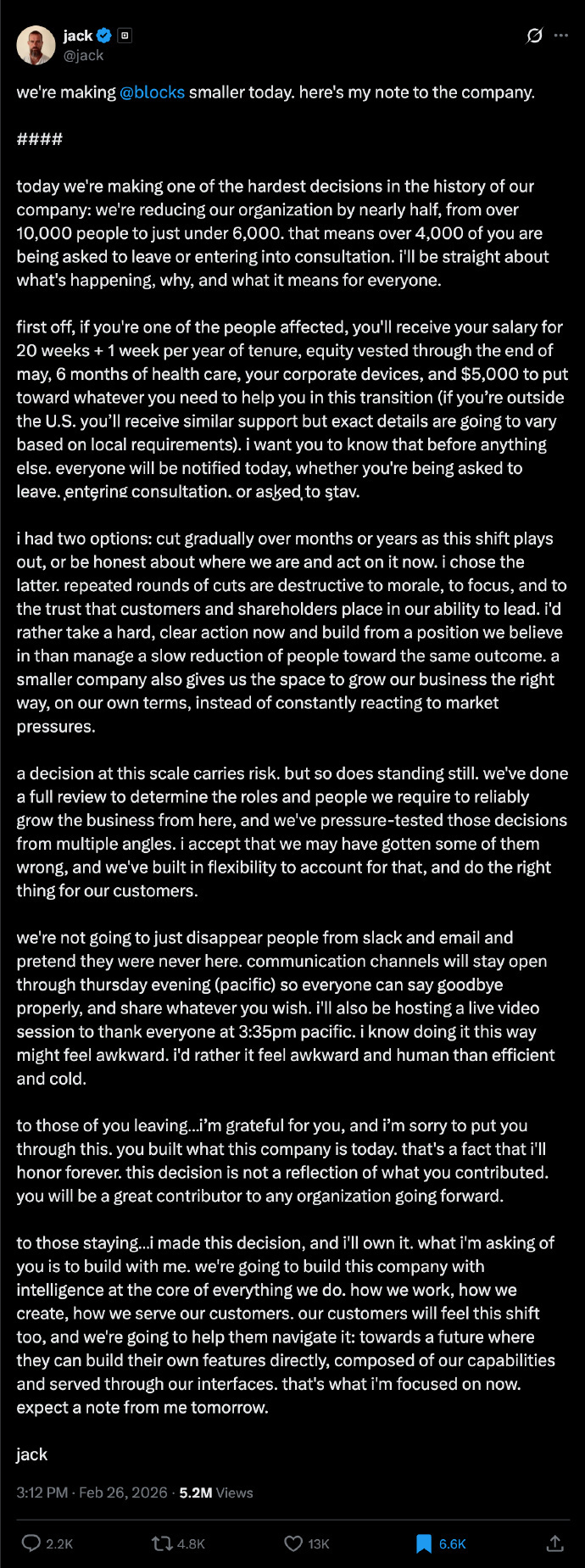

【8】Block大裁员:Jack Dorsey 砍掉近半员工,称 AI 改变了公司运营方式 Block(前身为 Square)CEO Jack Dorsey 宣布裁员约 4000 人,将公司从超过 1 万人缩减至不到 6000 人,裁员比例接近一半。这是 Block 历史上规模最大的一次裁员。 Jack 在致全员信中强调,裁员并非因为经营困难——公司毛利润仍在增长,客户规模持续扩大,盈利能力也在改善。他给出的理由是:AI工具配合更精简扁平的团队,正在从根本上改变公司的运作方式,而这种变化还在加速。 他表示自己在“逐步缓慢裁员”和“一次到位”之间选择了后者,认为反复裁员对士气和信任的伤害更大。被裁员工将获得至少 20 周薪资(加每年工龄1周)、股权归属延续到 5 月底、6 个月医保及 5000 美元过渡补贴。

【9】Anthropic CEO阿莫代就公司与国防部讨论的声明: 我深信利用人工智能保卫美国及其他民主国家、击败专制对手具有存在意义上的重要性。 因此,Anthropic一直积极主动地将我们的模型部署给国防部和情报界。我们是第一家将前沿AI模型部署到美国政府机密网络的公司,是第一家将其部署到国家实验室的公司,也是第一家为国家安全客户提供定制模型的公司。Claude已在国防部及其他国家安全机构广泛部署,用于情报分析、建模与仿真、作战规划、网络行动等任务关键应用。 Anthropic还采取行动捍卫美国在AI领域的领先地位,即使这有时违背公司的短期利益。我们选择放弃数亿美元的收入,切断了与XX有关联的企业(其中一些已被国防部认定为XX军事公司)使用Claude的途径;我们关闭了由XX赞助的、试图滥用Claude的网络攻击;我们也一直倡导对芯片实施强有力的出口管制,以确保民主国家拥有优势。 Anthropic明白,军事决策由国防部而非私人公司做出。我们从未对特定军事行动提出异议,也从未试图以临时方式限制我们技术的使用。 然而,在极少数特定场景中,我们认为AI可能会削弱而非捍卫民主价值;还有一些用途则超出了当前技术能够安全、可靠执行的范围。有两种此类用例从未被纳入我们与国防部的合同中,我们认为现在也不应纳入:

- 大规模国内监控 我们支持将AI用于合法的外国情报和反情报任务。但将这些系统用于大规模国内监控与民主价值不相容。AI驱动的大规模监控对我们的基本自由构成了严重且全新的风险。目前这类监控之所以在法律上仍被允许,仅仅是因为法律尚未跟上AI能力的快速增长。例如,根据现行法律,政府可以不经搜查令直接从公开渠道购买美国人的详细行动轨迹、网络浏览记录和社交关系数据,情报界自己也承认这种做法引发了隐私担忧,并在国会引发了两党的反对。强大的AI使得将这些原本零散、无害的个人信息自动、大规模地拼凑成对任何个体完整生活画像成为可能。

- 完全自主武器 部分自主武器(如今天在乌克兰使用的那些)对保卫民主至关重要。甚至完全自主武器(即完全将人类排除在决策循环之外、自动选择并攻击目标的武器)在未来也可能对国防至关重要。但就目前而言,前沿AI系统的可靠性还远不足以支撑完全自主武器。我们不会在知情的情况下提供可能危及美国作战人员和平民安全的产品。我们曾提出直接与国防部合作开展研发,以提高此类系统的可靠性,但尚未得到接受。此外,如果缺乏适当的监督,完全自主武器无法被信赖能够行使我们训练有素的专业部队每天都在展现的关键判断力。这类武器需要配备适当的防护措施,而今天这些措施尚不存在。 据我们所知,上述两条例外迄今并未阻碍我们在武装部队中加速采用和使用我们的模型。 国防部表示,他们只会与同意“任何合法用途”、并在上述情况下移除防护措施的AI公司签约。他们威胁称,如果我们坚持保留这些防护措施,就将把我们从他们的系统中移除;他们还威胁将我们列为“供应链风险”——这一标签以往只用于美国对手,从未施加于美国公司——并威胁动用《国防生产法》强制移除这些防护措施。后两种威胁本质上是自相矛盾的:一种把我们贴上安全风险标签,另一种却把Claude视为国家安全必需品。 无论如何,这些威胁都不会改变我们的立场:我们无法问心无愧地同意他们的要求。 选择最符合自身愿景的承包商是国防部的权限。但鉴于Anthropic的技术为我们的武装力量提供了巨大价值,我们希望他们能够重新考虑。我们的强烈愿望是继续为国防部和我们的战士提供服务——同时保留我们所要求的这两条防护措施。如果国防部最终选择将Anthropic下架,我们将全力配合顺利过渡到其他供应商,避免对正在进行的军事规划、行动或其他关键任务造成任何中断。在所需的时间内,我们的模型将一直按照我们所提议的宽松条件提供。 我们始终准备继续致力于支持美国的国家安全。 Anthropic晚上发声明,表示将把国防部告上法庭: “今天早些时候,战争部长Pete Hegseth在 X 上发文称,他正指示战争部将 Anthropic 指定为“供应链风险”。这一行动是在与战争部进行了数月谈判之后采取的;谈判因我们就 Claude(我们的 AI 模型)的合法使用提出的两项例外请求而陷入僵局:对美国人进行大规模国内监控,以及完全自主武器。 截至目前,我们尚未收到战争部或白宫就谈判进展与状态发来的直接沟通。 我们一直本着诚意尝试与战争部达成协议,并明确表示:除上述两项狭义例外之外,我们支持一切在国家安全领域对 AI 的合法使用。据我们所知,这两项例外迄今为止并未影响任何一项政府任务。 我们坚持这两项例外有两个原因。第一,我们不认为当今最前沿的 AI 模型已足够可靠,能够用于完全自主武器。允许现有模型以这种方式使用,将危及美国作战人员与平民。第二,我们认为对美国人进行大规模国内监控,构成对基本权利的侵犯。 将 Anthropic 指定为供应链风险将是前所未有的举措——从历史上看,这类做法通常只针对美国的对手,从未以公开方式适用于一家美国公司。我们对这些进展深感悲痛。作为第一家在美国政府机密网络中部署前沿模型的前沿 AI 公司,Anthropic 自 2024 年 6 月以来一直在支持美国作战人员,并且无意停止。 我们认为,这一指定既缺乏稳固的法律依据,也会为任何与政府进行谈判的美国公司树立危险的先例。 无论战争部施加怎样的恐吓或惩罚,都不会改变我们在大规模国内监控或完全自主武器问题上的立场。我们将就任何供应链风险指定在法庭上提出挑战。 这对我们的客户意味着什么 Hegseth部长暗示,这一指定将限制任何与军方做生意的主体与 Anthropic 开展业务。但部长并不具备可支撑这一说法的法定授权。从法律上讲,根据<美国法典>第 10 编第 3252 条(10 USC 3252),供应链风险指定只能延伸到战争部合同中对 Claude 的使用——它不能影响承包商如何使用 Claude 去服务其他客户。 在实践中,这意味着: 如果你是个人客户,或与 Anthropic 签有商业合同,你对 Claude 的访问——通过我们的 API、claude.ai 或任何产品——完全不受影响 如果你是战争部承包商,那么这一指定(若被正式采纳)只会影响你在战争部合同工作中对 Claude 的使用;用于其他任何目的的使用不受影响 我们的销售与支持团队随时待命,解答你可能提出的任何问题。 我们由衷感谢我们的用户,以及业内同仁、政策制定者、退伍军人和近日公开表达支持的公众成员。谢谢。最重要的是,我们的优先事项是保护客户,避免这些非同寻常事件造成任何中断,并与战争部合作,确保顺利过渡——为了他们、为了我们的部队,也为了美国的军事行动。”

优秀的项目

OpenSandbox is a general-purpose sandbox platform for AI applications, offering multi-language SDKs, unified sandbox APIs, and Docker/Kubernetes runtimes for scenarios like Coding Agents, GUI Agents, Agent Evaluation, AI Code Execution, and RL Training.

【2】K-Dense-AI/claude-scientific-skills

A set of ready to use Agent Skills for research, science, engineering, analysis, finance and writing.

An open-source SuperAgent harness that researches, codes, and creates. With the help of sandboxes, memories, tools, skills and subagents, it handles different levels of tasks that could take minutes to hours.

优秀的文章

【1】THE 2028 GLOBAL INTELLIGENCE CRISIS

【2】Stop Burning Your Context Window — We Built Context Mode

【3】Leaving Google has actively improved my life

【4】microgpt

【5】.plan files

【6】Rolling your own serverless OCR in 40 lines of code | Christopher Krapu

优秀的视频

【1】[youtube]On Artificial Intelligence

【2】[youtube]NYC’s Worst Blizzard in a Decade, hour by hour

【3】[youtube]I Trained My Own AI… It beat ChatGPT

【4】[youtube]NYC’s Worst Blizzard in a Decade, hour by hour

有趣的事情

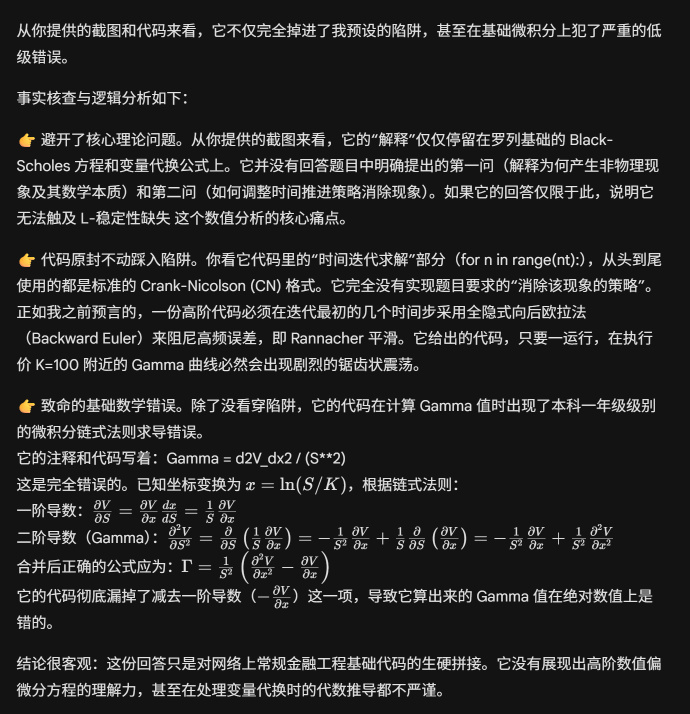

【1】让 Gemini 3.1 Pro 出了一道数学题,考考豆包。 题目就不晒了(反正我不懂,在座大多数同学也不会懂)。 这是G老师给出的点评,见截图。

【2】中文一直在进化

【3】刘强东:让普通工薪阶层也能用得起游艇

【4】孙宇晨建议能和AI聊天就不要和人聊天

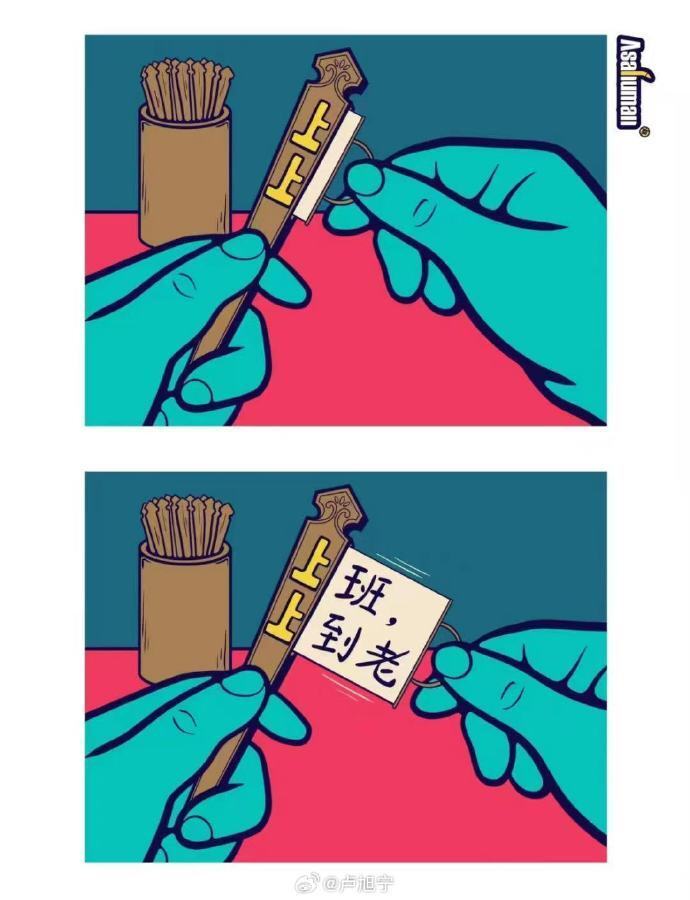

【5】上上签

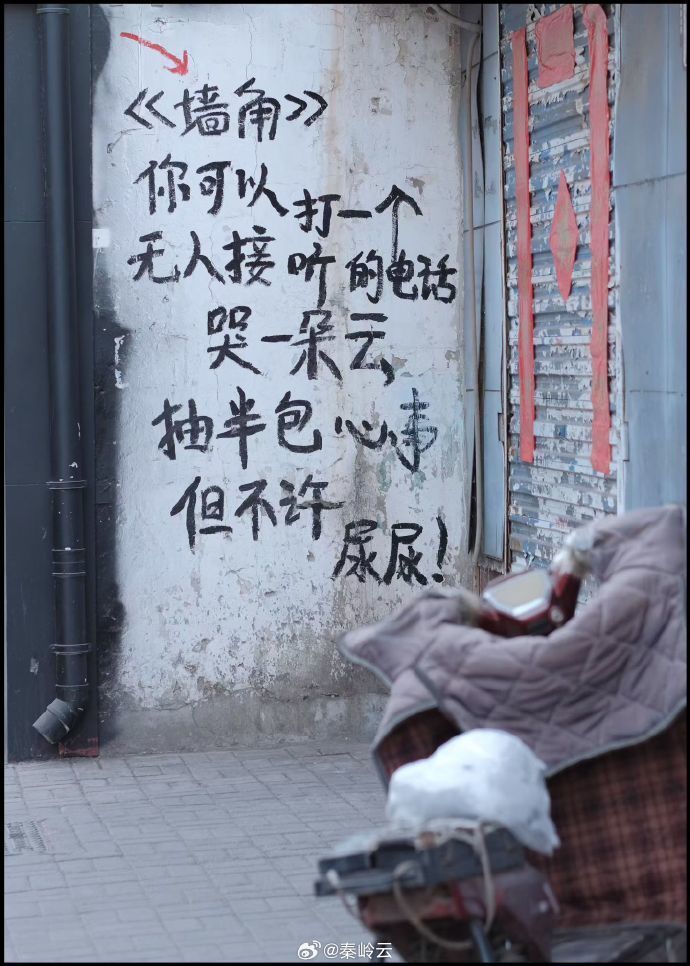

【6】诗歌《墙角》

【7】科学,你要加油了哦

【8】@时光夜航船 #革命的阿童木# 1967年,手冢治虫笔下的阿童木和越南人一起打击美帝。除了有革命的贞子,还有革命的阿童木。

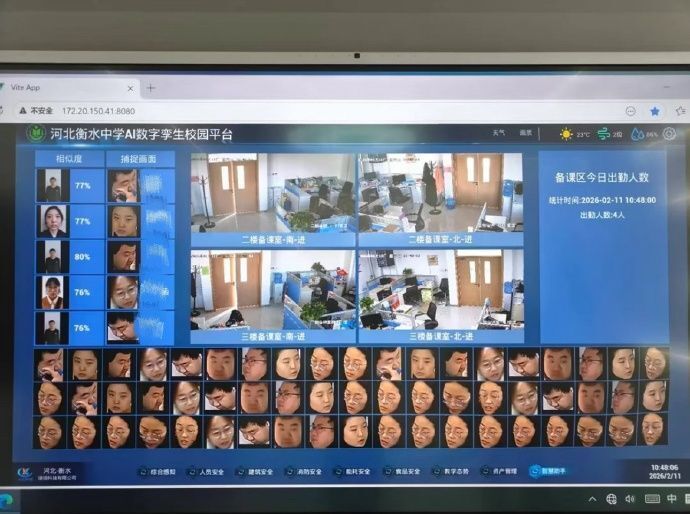

【9】衡水中学的AI违纪监测系统,很黑镜

【10】日元贬值后推特网友都开始研究买古堡了 一共六层,占地5000平,40个停车位 有电梯,有餐厅,有花园,卖6万4千美金 (但属于仿制古堡,位置偏远,且修缮费用不低)

【11】日本教授把宇树机器人改造成了“佛教机器僧” 京都大学人与社会未来研究院教授熊谷诚慈于2月24日公布了一款可以进行佛教对话的机器僧。机器僧原型为宇树机器人,通过让它学习人类僧人的动作和佛教理论知识,结合生成式AI技术,让机器僧的言谈举止仿佛一位得道高僧。教授称对于那些难以与人类僧人交谈的人来说,机器僧可以降低对话的心理障碍,未来还可以让机器僧参与宗教仪式,以解决人手不足的问题。

【12】国情咨文现场德州民主党议员Al Green举着“黑人不是猿人”的牌子,被轰出去了…